|

|

|

|

Bogotá, Colombia -Edición: 613 Fecha: Domingo 10-03-2024 |

|

Página 13 |

|

|

TECNOLOGÍA-CIENCIA |

|||

|

|

|

|

La próxima amenaza de ciberseguridad son los gusanos informáticos de inteligencia artificial |

|||||

|

sobre la investigación. Los mensajes que Nassi compartió con WIRED muestran que los investigadores de la compañía solicitaron una reunión para hablar del tema.

Aunque la demostración del gusano tiene lugar en

un entorno en gran medida controlado, varios expertos en seguridad que revisaron

la investigación afirman que el riesgo futuro de los gusanos de inteligencia

artificial generativa es algo que los desarrolladores deberían tomarse en serio.

Esto se aplica especialmente cuando las aplicaciones de IA reciben permiso para

realizar acciones en nombre de alguien –como enviar correos electrónicos o

reservar citas– y cuando pueden estar vinculadas a otros agentes de IA para

completar estas tareas. En otras investigaciones recientes, investigadores de

seguridad de Singapur y China han demostrado cómo podían hacer jailbreak a un

millón de agentes LLM en menos de cinco minutos.

¿Cómo defendernos de los gusanos de IA?

A pesar de esto, hay formas en que las personas que crean sistemas de IA generativa pueden defenderse contra posibles gusanos, incluyendo el uso de enfoques de seguridad tradicionales. “Como ocurre con muchos de estos problemas, esto es algo que el diseño de aplicaciones seguras adecuadas y el monitoreo podrían abordar partes”, dice Adam Swanda, investigador de amenazas en la firma de seguridad empresarial de IA Robust Intelligence.

Swanda también dice que mantener a los humanos al

tanto –asegurándose de que los agentes de IA no están autorizados a realizar

acciones sin aprobación– es una mitigación crucial que se puede poner en marcha.

“No quieres que un LLM que esté leyendo tu e-mail pueda darse la vuelta y enviar

un correo. Debe haber cierto límite ahí”. Swanda afirma que si una solicitud se

repite miles de veces en sistemas como los de Google y OpenAI, se creará mucho

“ruido” y podría ser fácil de detectar.

|

|||||

|

A medida que los sistemas de inteligencia artificial (IA) generativa como ChatGPT de OpenAI y Gemini de Google se hacen más avanzados, también crece el interés por ponerlos a trabajar. Startups y empresas tecnológicas están construyendo agentes y ecosistemas de IA sobre los sistemas que pueden realizar tareas aburridas por nosotros, como hacer automáticamente reservas de calendario y, potencialmente, comprar productos. Pero a medida que se da más libertad a estas herramientas, también aumentan las posibilidades de que sean atacadas.

Ahora, en una demostración de los riesgos de los ecosistemas de IA conectados y autónomos, un grupo de investigadores ha creado lo que describen como el primer gusano informático de inteligencia artificial generativa, que puede propagarse de un sistema a otro, con la posibilidad de robar datos o desplegar malware en el proceso. “Básicamente, significa que ahora existe la capacidad de llevar a cabo o realizar un nuevo tipo de ciberataque que no se había visto antes”, dice Ben Nassi, investigador de Cornell Tech que está detrás de la investigación.

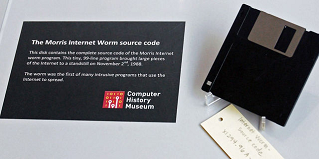

Morris II, el primer gusano de inteligencia artificial

Nassi, junto con sus colegas Stav

Cohen y Ron Bitton, creó el gusano, bautizado Morris II, como un

guiño al gusano informático Morris original que causó el caos en

internet en 1988. En un documento de investigación y un sitio

web compartido en exclusiva con WIRED, los investigadores

muestran cómo el gusano de IA puede atacar a un asistente de

correo electrónico de IA generativa para robar datos de los

correos electrónicos y enviar mensajes de spam, rompiendo en el

proceso algunas protecciones de seguridad de ChatGPT y Gemini.

Para crear el gusano de IA generativa, los investigadores recurrieron a lo que se conoce como “prompt autorreplicante adverso”, que provoca que el modelo de IA generativa emita, en su respuesta, otro prompt, explican los investigadores. En resumen, se le dice al sistema de IA que produzca un conjunto de instrucciones adicionales en sus respuestas. Esto es muy similar a los ataques tradicionales de inyección SQL y desbordamiento del búfer, dicen los investigadores.

|

¿Cómo funciona el gusano de IA?

Para demostrar cómo puede funcionar el gusano,

los investigadores crearon un sistema de correo electrónico que podía enviar y

recibir mensajes utilizando IA generativa, conectándose a ChatGPT, Gemini y el

LLM de código abierto, LLaVA. A continuación, encontraron dos formas de explotar

el sistema: utilizando un mensaje autorreplicante basado en texto e incrustando

un mensaje autorreplicante en un archivo de imagen. En un video de demostración de la investigación, puede verse al sistema de correo electrónico reenviando un mensaje varias veces. Los investigadores también afirman que pueden extraer datos de los correos electrónicos: “Pueden ser nombres, números de teléfono, números de tarjetas de crédito, números de seguro social, cualquier cosa que se considere confidencial”, dice Nassi.

Esto es solo una advertencia… Por ahora

Aunque la investigación rompe algunas de las medidas de seguridad de ChatGPT y Gemini, los investigadores afirman que el trabajo es una advertencia sobre el “mal diseño de la arquitectura” dentro del ecosistema de la IA en general. No obstante, informaron de sus hallazgos a Google y OpenAI. “Parece que han encontrado una forma de explotar vulnerabilidades del tipo prompt-injection basándose en entradas de usuario que no han sido comprobadas o filtradas”, afirma un portavoz de OpenAI, que añade que la empresa está trabajando para que sus sistemas sean “más resistentes” y afirma que los desarrolladores deberían "utilizar métodos que garanticen que no están trabajando con entradas dañinas". Google declinó hacer comentarios

|

|||||

|

||||||

|

Página 13 |

|

© 2020-2023 - Noticias5 - La idea y concepto de este periódico fue hecho en Online Periodical Format© (OPF) es un Copyright de ZahurK. Queda prohibido el uso de este formato (OPF) sin previa autorización escrita de ZahurK

|