|

|

|

Bogotá, Colombia -Edición: 629 Fecha: Miércoles 17-04-2024 |

|

|

Página 12 |

|

|

|

TECNOLOGÍA-CIENCIA |

||

|

|

El Consejo de Supervisión de Meta investigará los deepfake no consentidos de celebridades |

|

||||

|

que circulaban por Facebook e Instagram

mostraban imágenes de una Jenna Ortega desnuda

siendo menor de edad. En la India, los deepfakes se han dirigido a importantes

actrices de Bollywood, como Priyanka Chopra Jonas, Alia Bhatt y Rashmika Mandann.

Aumenta el acoso

Según Thorning-Schmidt, "la pornografía deepfake es una causa creciente de acoso por razón de género en internet y se utiliza cada vez más para atacar, silenciar e intimidar a las mujeres dentro y fuera de la red", y "múltiples estudios muestran que la pornografía deepfake se dirige abrumadoramente a las mujeres. Este contenido puede ser extremadamente perjudicial para las víctimas, y las herramientas utilizadas para crearlo son cada vez más sofisticadas y accesibles".

En enero, los legisladores presentaron la Ley

Disrupt Explicit Forged Images and Non-Consensual Edits, o Ley DEFIANCE, que

permitiría a las personas cuyas imágenes se utilizaron en porno deepfake,

demandar si pudieran demostrar que se hizo sin su consentimiento. La congresista

Alexandria Ocasio-Cortez, que patrocinó el proyecto de ley, fue ella misma

objeto de pornografía deepfake a principios de este año.

|

|||||

|

A medida que las herramientas de IA se

vuelven más sofisticadas y accesibles, también lo ha hecho una de sus

peores aplicaciones: la pornografía deepfake no consentida. Aunque gran

parte de este contenido se aloja en sitios dedicados, cada vez se cuela

más en las plataformas sociales. El día de ayer, el Consejo de

Supervisión de Meta ha anunciado que se está ocupando de casos que

podrían obligar a la empresa a ajustar cuentas sobre cómo trata la

pornografía deepfake.

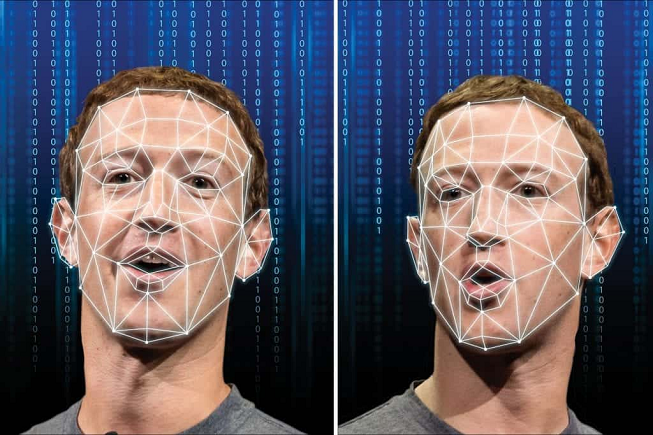

El Consejo, que es un organismo independiente que puede emitir tanto decisiones vinculantes como recomendaciones a Meta, se centrará en dos casos de porno deepfake, ambos relacionados con celebridades cuyas imágenes fueron alteradas para crear contenido explícito. En uno de esos casos, relativo a una persona famosa estadounidense cuyo nombre se desconoce, se retiró de Facebook la pornografía falsa en la que aparecía, después de que ya se hubiera señalado en otros lugares de la plataforma. La publicación también se añadió al Media Matching Service Bank, de Meta, un sistema automatizado que encuentra y elimina imágenes que ya han sido marcadas como contrarias a las políticas de Meta, para mantenerlas así fuera de la plataforma.

En el otro caso, una imagen falsa de

una celebridad india, también sin nombre, permaneció en Instagram

incluso después de que los usuarios la denunciaran por infringir las

políticas de Meta sobre pornografía. El deepfake de la celebridad india

fue retirado una vez que el Consejo se hizo cargo del caso, según el

anuncio. En ambos casos, las imágenes se retiraron por infringir las políticas de Meta sobre acoso e intimidación, y no entraban dentro sus políticas sobre pornografía. Meta, sin embargo, prohíbe "contenidos que muestren, amenacen o promuevan la violencia sexual, la agresión sexual o la explotación sexual" y no permite anuncios pornográficos o sexualmente explícitos en sus plataformas. En una entrada de blog publicada junto con el anuncio de los casos, Meta dijo que eliminó las publicaciones por violar la parte de "photoshops o dibujos sexualizados despectivos" de su política de intimidación y acoso, y que también "determinó que violaba la política de desnudez y actividad sexual [de Meta] para adultos".

La dificultad de detectar porno deepfake

El Consejo espera utilizar estos casos para examinar las políticas y los sistemas de Meta para detectar y eliminar la pornografía

|

deepfake no consentida, según Julie Owono, miembro del Consejo de Supervisión. "Ya puedo decir provisionalmente que el principal problema es probablemente la detección", declara. "La detección no es tan perfecta o, al menos, no es tan eficiente como desearíamos".

Meta también se enfrenta desde hace tiempo a

críticas por su enfoque a la hora de moderar contenidos fuera de Estados Unidos

y Europa Occidental. Para este caso, el Consejo ya expresó su preocupación por

el hecho de que la celebridad estadounidense y la celebridad india recibieran un

trato diferente en respuesta a sus deepfakes aparecidos en la plataforma.

Un fenómeno que crece y preocupa

EL Consejo se negó a nombrar a las celebridades indias y estadounidenses cuyas imágenes motivaron las quejas, pero las deepfakes pornográficas de celebridades se han convertido en un fenómeno desenfrenado. Una reciente investigación de Channel 4 descubrió deepfakes de más de 4,000 famosos. En enero, un deepfake no consentido de Taylor Swift se hizo viral en Facebook, Instagram y, sobre todo, X, donde una publicación obtuvo más de 45 millones de visitas. X recurrió a restringir el nombre de la cantante de su función de búsqueda, pero las publicaciones siguieron circulando. Y mientras las plataformas se esforzaban por eliminar el contenido, fueron los fans de Swift quienes denunciaron y bloquearon las cuentas que compartían la imagen. En marzo, NBC News informó de que los anuncios de una aplicación de deepfakes

|

|||||

|

||||||

|

Página 12 |