|

|

|

Bogotá, Colombia -Edición: 622 Fecha: Domingo 31-03-2024 |

|

|

Página 12 |

|

|

TECNOLOGÍA-CIENCIA |

|||

|

|

|

|

Surge un modelo de IA de código abierto que se puede considerar como el más poderoso del mundo |

|||||

|

meses. Crucialmente, descubrieron que a medida que se ampliaba el modelo y el conjunto de datos en el que se entrenaba, los modelos se volvían más capaces, coherentes y aparentemente inteligentes en su salida.

Buscar una escala aún mayor sigue siendo una obsesión de OpenAI y otras empresas líderes en IA. El CEO de OpenAI, Sam Altman, ha buscado $7 billones en financiamiento para desarrollar chips especializados en IA, según The Wall Street Journal. Pero no solo el tamaño importa al crear un modelo de lenguaje. Frankle dice que se toman docenas de decisiones al construir una red neuronal avanzada, con algunas tradiciones sobre cómo entrenar de manera más eficiente que se pueden deducir de documentos de investigación, y otros detalles se comparten dentro de la comunidad. Es especialmente desafiante mantener a miles de computadoras conectadas por interruptores quisquillosos y cables de fibra óptica trabajando juntos.

“Tienes estos interruptores de red [network] insanos que hacen terabits por segundo de ancho de banda que entran desde múltiples direcciones diferentes”, dijo Frankle antes de que se completara la última ejecución de entrenamiento. “Es alucinante incluso para alguien que ha pasado su vida en la informática”. Que Frankle y otros en MosaicML sean expertos en esta ciencia oscura ayuda a explicar por qué la compra de Databricks de la startup el año pasado la valoró en $1.3 mil millones.

Los datos alimentados a un modelo también hacen una gran diferencia en el resultado final, tal vez explicando por qué es el único detalle que Databricks no está divulgando abiertamente. “La calidad de los datos, la limpieza de los datos, el filtrado de los datos, la preparación de los datos es muy importante”, dice Naveen Rao, vicepresidente de Databricks y anteriormente fundador y CEO de MosaicML. “Estos modelos son realmente solo una función de eso. Casi puedes pensar en eso como lo más importante para la calidad del modelo”.

Los investigadores de IA continúan inventando ajustes de arquitectura y modificaciones para hacer que los modelos de IA más recientes sean más eficientes. Uno de los avances más significativos recientes ha llegado gracias a una arquitectura conocida como "mezcla de expertos", en la que solo algunas partes de un modelo se activan para responder a una consulta, dependiendo de su contenido. Esto produce un modelo que es mucho más eficiente para entrenar y operar. DBRX tiene alrededor de 136 mil millones de parámetros, o valores dentro del modelo que se actualizan durante el entrenamiento. Llama 2 tiene 70 mil millones de parámetros, Mixtral tiene 45 mil millones y Grok tiene 314 mil millones. Pero DBRX solo activa unos 36 mil millones en promedio para procesar una consulta típica. Databricks dice que los ajustes al modelo diseñados para mejorar su utilización del hardware subyacente ayudaron a mejorar la eficiencia del entrenamiento entre un 30 y un 50 por ciento. También hace que el modelo responda más rápidamente a las consultas y requiera menos energía para funcionar, dice la compañía.

|

|||||

|

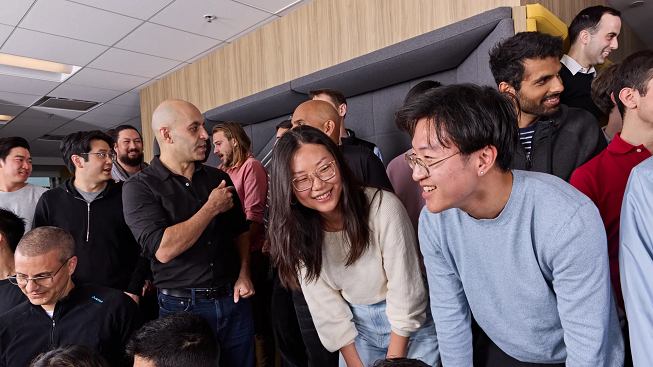

Este pasado lunes, aproximadamente

una docena de ingenieros y ejecutivos de la compañía de ciencia

de datos e inteligencia artificial Databricks se reunieron en

salas de conferencias conectadas a través de Zoom para saber si

habían tenido éxito en construir un modelo de lenguaje de

inteligencia artificial de primer nivel. El equipo había gastado

meses y alrededor de $10 millones entrenando DBRX, un modelo de

lenguaje grande similar en diseño al que está detrás de ChatGPT

de OpenAI. Pero no sabrían cuán poderosa era su creación hasta

que llegaran los resultados de las pruebas finales de sus

habilidades.

"Lo hemos superado todo",

eventualmente le dijo a su equipo Jonathan Frankle, arquitecto

jefe de redes neuronales en Databricks y líder del equipo que

construyó DBRX, lo que generó vítores, aplausos y emojis de

aplauso entre los presentes. Frankle generalmente evita la

cafeína, pero tomaba sorbos de un latte helado después de pasar

toda la noche en vela escribiendo los resultados.

Superó a Llama 2 de Meta y a

Mixtral de Mistral, dos de los modelos de IA de código abierto

más populares disponibles hoy en día. "¡Sí!" gritó Ali Ghodsi,

CEO de Databricks, cuando aparecieron los puntajes. "Espera,

¿superamos la cosa de Elon?" Frankle respondió que de hecho

habían superado el modelo Grok AI recientemente abierto al

público por xAI de Musk, agregando: "Lo consideraré un éxito si

recibimos un tuit desagradable de él".

Bloques de Construcción

Al publicar DBRX como código abierto, Databricks está añadiendo más impulso a un movimiento que está desafiando el enfoque secreto de las empresas más prominentes en el actual auge de la IA generativa. OpenAI y Google mantienen el código para sus modelos de lenguaje de gran tamaño GPT-4 y Gemini muy resguardados, pero algunos rivales, notablemente Meta, han liberado sus modelos para que otros los usen, argumentando que impulsará la innovación al poner la tecnología en manos de más investigadores, emprendedores, startups y empresas establecidas.

Databricks dice que también quiere ser transparente sobre el trabajo involucrado en la creación de su modelo de código abierto, algo que Meta no ha hecho para algunos detalles clave sobre la creación de su modelo Llama 2. La compañía publicará una entrada de blog detallando el trabajo involucrado para crear el modelo, y también mostrará cómo los ingenieros toman decisiones clave durante las etapas finales

|

del proceso multimillonario de entrenar a DBRX. Eso proporcionó una visión de lo complejo y desafiante que es construir un modelo de IA líder, pero también de cómo las innovaciones recientes en el campo prometen reducir los costos. Eso, combinado con la disponibilidad de modelos de código abierto como DBRX, sugiere que el desarrollo de la IA no está a punto de disminuir en el corto plazo.

Ali Farhadi, CEO del Instituto Allen de IA, dice

que se necesita con urgencia una mayor transparencia en la construcción y

entrenamiento de modelos de IA. El campo se ha vuelto cada vez más secreto en

los últimos años a medida que las empresas buscan una ventaja sobre sus

competidores. La opacidad es especialmente importante cuando hay preocupación

por los riesgos que los modelos avanzados de IA podrían representar, dice.

"Estoy muy contento de ver cualquier esfuerzo en apertura", dice Farhadi. “Creo

que una parte significativa del mercado se inclinará hacia modelos abiertos.

Necesitamos más de esto”.

Funcionamiento Interno

DBRX, como otros modelos de lenguaje grandes, es

esencialmente una red neuronal artificial gigante, un marco matemático vagamente

inspirado en neuronas biológicas, que ha sido alimentado con enormes cantidades

de datos de texto. DBRX y sus similares generalmente se basan en el

transformador, un tipo de red neuronal inventado por un equipo de Google en 2017

que revolucionó el aprendizaje automático para el lenguaje.

|

|||||

|

||||||

|

Página 13 |

|

© 2020-2023 - Noticias5 - La idea y concepto de este periódico fue hecho en Online Periodical Format© (OPF) es un Copyright de ZahurK. Queda prohibido el uso de este formato (OPF) sin previa autorización escrita de ZahurK

|