|

|

|

|

Bogotá, Colombia -Edición: 625 Fecha: Domingo 07-04-2024 |

|

Página 13 |

|

|

TECNOLOGÍA-CIENCIA |

|||

|

|

|

|

La fibra óptica podría ser la pieza clave en la creación de supercomputadoras de IA |

|||||

|

“El paso facilitará algoritmos de IAG”,

sugiere convencido.

Los grandes centros de datos necesarios para entrenar algoritmos enormes de IA suelen constar de racks llenos de miles de computadoras con chips de silicio especializados y un spaghetti de conexiones, en su mayoría eléctricas, entre ellas. Mantener los procesos de entrenamiento de la IA en tantos sistemas, todos conectados por cables e interruptores, es una gigantesca labor de ingeniería. La conversión entre señales electrónicas y ópticas también impone límites fundamentales a la capacidad de los chips para ejecutar operaciones de procesamiento como si fueran uno solo.

El enfoque de Lightmatter está diseñado para simplificar el complicado tráfico dentro de los centros de datos de IA. “Normalmente tienes un montón de GPU, y después una capa de conmutadores, y otra capa, y otra más, y debes atravesar ese árbol” para comunicarte entre dos GPU, explica Harris. En un centro de datos conectado por Passage, destaca Harris, cada GPU dispondría de una conexión de alta velocidad con cada uno de los demás chips.

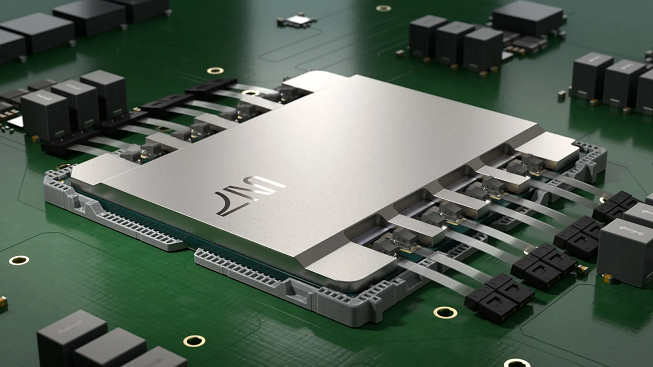

El trabajo de Lightmatter con Passage es un ejemplo del modo en que el reciente florecimiento de la IA ha inspirado a empresas grandes y pequeñas a intentar reinventar el hardware clave detrás de avances como el ChatGPT de OpenAI. Nvidia, el principal proveedor de GPU para proyectos de inteligencia artificial, celebró su conferencia anual el mes pasado, en la que Jensen Huang, su CEO, presentó el último chip de la compañía para el entrenamiento de IA: una GPU llamada Blackwell, que venderá como un “superchip” compuesto por dos GPU Blackwell y un procesador CPU convencional, todo ello conectado mediante la nueva tecnología de comunicaciones de alta velocidad de la compañía conocida como NVLink-C2C.

|

|||||

|

La mayoría de los expertos en

inteligencia artificial (IA) parecen estar de acuerdo en que dar

el próximo gran salto en este campo dependerá, al menos en

parte, de la construcción de supercomputadoras a una escala

antes inimaginable. En un evento organizado por la empresa de

capital de riesgo Sequoia el mes pasado, el CEO de una startup

llamada Lightmatter presentó una tecnología que quizá haga

posible este replanteamiento de la informática a hiperescala, al

permitir que los chips se comuniquen directamente entre sí

mediante la luz.

Fibra óptica para acelerar los procesos de la IA

Hoy en día, la información se mueve generalmente dentro de las computadoras, y en el caso del entrenamiento de algoritmos de IA, entre chips dentro de un centro de datos, mediante señales eléctricas. A veces, partes de esas interconexiones se transforman en enlaces de fibra óptica para obtener un gran ancho de banda, pero la conversión de señales de ida y vuelta entre ópticas y eléctricas crea un cuello de botella en las comunicaciones.

En su lugar, Lightmatter quiere

conectar directamente miles o incluso millones de unidades de

procesamiento gráfico (GPU, por sus siglas en inglés), esos

chips de silicio que son fundamentales para el entrenamiento de

la IA, empleando enlaces de fibra óptica. Reducir el cuello de

botella de la conversión debería facilitar el movimiento de

datos entre los chips a velocidades mucho mayores que las

actuales, lo que posibilitaría la creación de supercomputadoras

de IA distribuidas en niveles extraordinarios.

|

ocasiones parece obsesionado con la cuestión

de construir centros de datos más grandes y rápidos para hacer avanzar aún más

la IA. En febrero, The Wall Street Journal informó que Altman ha buscado fondos

por un valor de hasta siete billones de dólares que destinaría al desarrollo de

inmensas cantidades de chips para la inteligencia artificial, mientras que un

reportaje más reciente de The Information sugiere que OpenAI y Microsoft están

diseñando planes para un centro de datos de 100,000 millones de dólares, cuyo

nombre en clave es Stargate, con millones de chips. Dado que las interconexiones

eléctricas consumen demasiada energía, conectar chips a tal escala requeriría

una cantidad extraordinaria de energía, y dependería de que hubiera nuevos

métodos, como los que propone Lightmatter.

Hacia una IA más capaz impulsada con luz

GlobalFoundries, una empresa que fabrica chips para otras, como AMD y General Motors, anunció previamente una asociación con Lightmatter. Harris señala que su organización está “trabajando con las mayores compañías de semiconductores del mundo, así como con los hiperescaladores”, refiriéndose a las mayores corporaciones dedicadas a servicios en la nube, como Microsoft, Amazon y Google.

Si Lightmatter u otra compañía consigue

reinventar el cableado de los gigantescos proyectos de IA, es posible que

desaparezca un cuello de botella crítico en el desarrollo de algoritmos más

inteligentes. El uso de más procesamiento fue fundamental para los avances que

condujeron a ChatGPT, y muchos investigadores en la materia consideran que

seguir incrementando el hardware es esencial para futuros avances en este campo

y para las esperanzas de alcanzar alguna vez el objetivo vagamente definido de

la inteligencia general artificial, o IAG, es decir, programas que igualen o

superen a la inteligencia biológica en todos los sentidos.

|

|||||

|

||||||

|

Página 13 |

|

© 2020-2023 - Noticias5 - La idea y concepto de este periódico fue hecho en Online Periodical Format© (OPF) es un Copyright de ZahurK. Queda prohibido el uso de este formato (OPF) sin previa autorización escrita de ZahurK

|